2026 年英伟达 GPU 技术大会明确传递的信息:人工智能(AI)的下一次飞跃取决于存储

如果说今年三月在加州圣何塞举行的 2026 年英伟达 GPU 技术大会上有一个贯穿始终的主题,那并不是更大的模型或更炫酷的演示,而是:

AI 的进步不再仅受限于算力,而是越来越受限于数据移动和存储的速度与效率。

以下五点启示无论您是在构建新的 AI 系统,还是在扩展现有系统,都至关重要。

1. 您的 GPU 性能好坏取决于您的数据管道

我们已正式进入这样一个时代:价值数万美元的加速器常常闲置,并非因为它们缺乏算力,而是因为它们在等待数据。

像英伟达这样的现代 GPU 专为大规模并行计算而设计,但只有通过高吞吐、低延迟的数据流持续供给,它们才能发挥效能。

饥饿的加速器不仅低效,而且代价高昂。这正是存储架构成为首要关注点的原因:

- 高性能 NVMe 层

- 并行文件系统

- 数据本地化策略

根据英伟达的说法,端到端的系统平衡对于实现 GPU 充分利用至关重要。1 在实践中,这意味着存储现在已成为您计算策略中不可或缺的一部分,而非事后才考虑的事项。

2. AI 发展迅速,但数据增长更快

AI 应用的发展一波接一波:

- **2024 年:** 聊天机器人

- **2025 年:** 副驾驶

- **2026 年:** 自主智能体

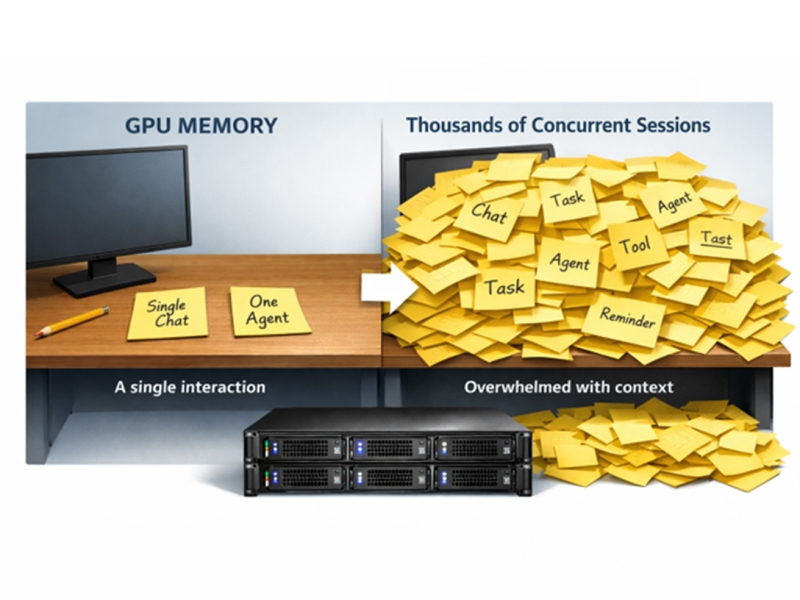

每向上一个层级,不仅价值提升,数据强度也随之增加。

智能体不仅仅是响应。它们会规划、迭代、调用工具并生成复杂的输出。这意味着一次用户交互可能激增为数十甚至数百次模型操作。

Gartner 等机构的行业研究已指出,基于智能体的系统将在本十年主导企业 AI 的采用,而这些系统从根本上更加渴求数据。2

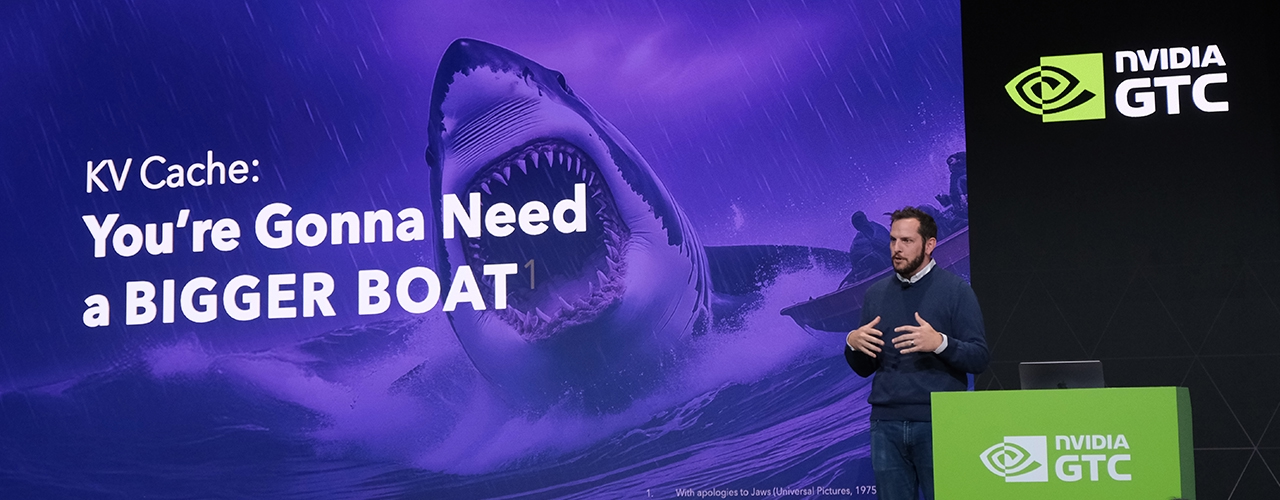

3. 推理正在成为新的数据海啸

训练过去一直主导着基础设施的讨论。但情况已不再如此。推理现在已成为规模扩展的主要驱动力,并且正变得越来越繁重:

- 更大的上下文窗口。更多信息请阅读这篇文章:《推理上下文内存存储 (ICMS)》:为什么 AI 推理正成为一个只有闪存才能解决的问题

- 检索增强生成 (RAG)。更多信息请阅读这篇文章:《通过 SSD 卸载技术解锁 AI 规模》

- 多步智能体工作流。

一个提示不会始终只是一个提示。它会分支。而所有这些都需要快速访问大型工作数据集。仅靠 DRAM 无法跟上,因为它过于昂贵且容量有限。这就是为什么我们看到向分层内存架构的转变,其中高性能 SSD 扩展了有效内存容量。

像英伟达这样的公司已经强调了存储在支持可扩展推理方面的作用,尤其是在模型越来越依赖外部数据的情况下。

4. 每瓦词元数才是真正重要的指标

AI 成功度的衡量方式正在发生悄然转变。关键不再是每秒词元数,而是每瓦词元数。

为什么? 因为电力是一个硬约束。运行大规模 AI 系统不仅硬件成本高昂,能源成本同样高昂。低效的系统无法经济地扩展,而提高效率并不总是依赖于新的芯片,往往在于提高存储密度、最小化空闲计算周期以及减少数据移动。

正如英伟达 GPU 技术大会上关于基础设施的讨论所强调,效率现在是一个系统级问题,而不仅仅是芯片问题。

5. AI 将同时实现集中式与分布式:存储两者皆能支持

在 AI 架构的讨论中存在一种错误的二分法,即集中式与边缘式的对立。现实情况是,您通常两者都需要。

集中式 AI 工厂负责模型训练、大规模推理和数据聚合。而边缘部署则用于实时决策、延迟敏感的工作负载以及具有高数据主权要求的应用。

什么将两者连接起来?存储

AI 工厂和边缘部署都需要高吞吐量、容量和可扩展性。如果没有存储性能和密度方面的持续突破,两者都无法充分发挥其潜力。

总结

随着限制因素的转变,AI 创新正在加速。在 2026 年,瓶颈不是算力,也不是模型,而是数据基础设施。

这正是 Solidigm 的用武之地。我们正以业界领先、专为性能、效率和规模打造的高容量存储,为下一代 AI 提供动力。因为归根结底,AI 的未来不仅取决于您思考的速度有多快,还取决于您向机器喂数据的速度有多快。

关于作者

Ace Stryker 是 Solidigm 公司 AI 生态系统营销总监,专注于公司数据中心存储解决方案组合的新兴应用。

参考文献